Google 新开源的 Gemma 4,手机上跑 4B 模型终于成真了

你的 iPhone 也能运行大模型了

导语

Google 刚刚发布了 Gemma 4 开源模型家族,同时推出了官方 App——Google AI Edge Gallery。E4B 模型只有 4B 参数,却能在 iPhone 上流畅运行。AI 正从云端走向你的掌心。

01 Gemma 4:Google 最聪明的开源模型

2026 年初,Google 发布了 Gemma 4 开源模型家族1。与之前的 Gemma 系列不同,这次 Google 采用了”有效参数”(Effective)的概念——E2B 和 E4B 模型在推理时只激活 2B 和 4B 参数,专门为移动设备和 IoT 设备优化。

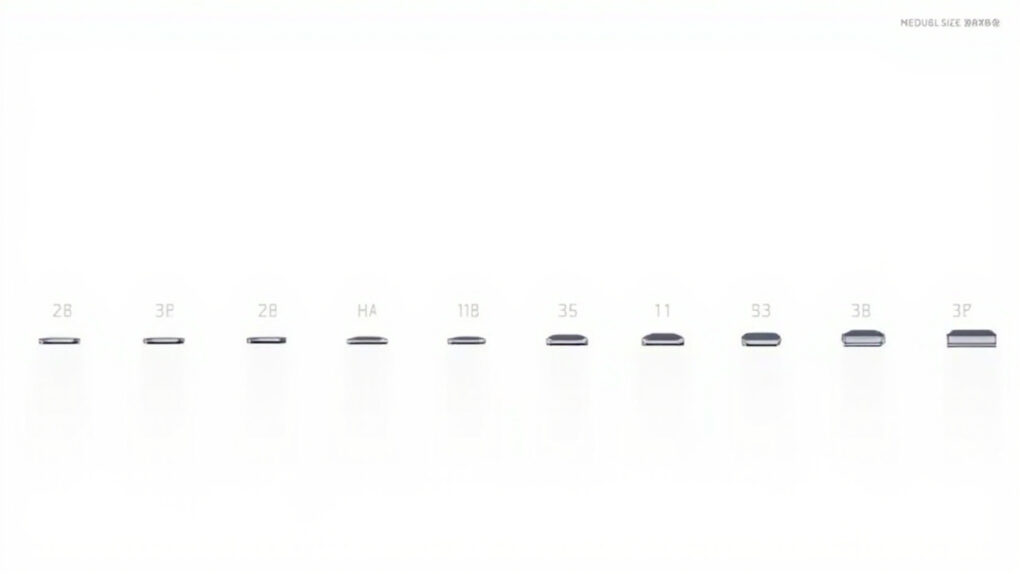

四个尺寸覆盖不同场景2:

| 模型 | 参数量 | 适用场景 |

|---|---|---|

| E2B | 2B | 手机、IoT 设备 |

| E4B | 4B | 手机、边缘设备 |

| 26B MoE | 26B(激活 3.8B) | 低延迟服务器 |

| 31B Dense | 31B | 工作站、GPU |

E2B 和 E4B 模型的设计目标是”完全离线、近零延迟”运行在手机等边缘设备上1。Google 与高通、联发科等芯片厂商合作,确保这些模型能在 Android 设备上原生运行1。

E4B 模型的特点1:

- 多模态支持:原生支持视频、图像、音频输入

- 128K 上下文:可处理长文档和代码仓库

- 140+ 语言:支持全球大多数语言

- Apache 2.0 许可:完全开源,可商用

02 Google 官方方案:AI Edge Gallery + Agent Skills

体验 Gemma 4 E2B/E4B 最直接的方式是使用 Google 官方推出的 Google AI Edge Gallery 应用3。

什么是 Google AI Edge Gallery?

这是 Google 官方开发的移动应用,允许你在设备上直接体验和实验 Gemma 4 的边缘 AI 能力3。

下载方式:

- iOS:App Store

- Android:Google Play

Agent Skills:手机上的 AI Agent

Google AI Edge Gallery 的核心功能是 Agent Skills——首批完全在设备上运行的多步骤自主 Agent 工作流应用3。

Agent Skills 能做什么:

- 扩展知识库:通过技能访问训练数据之外的信息,例如查询 Wikipedia 回答百科问题

- 端到端体验:通过对话管理复杂工作流,甚至可以创建完整的应用程序

- 完全离线:所有推理在本地完成,数据不出设备

官方示例4:

- Wikipedia 查询技能

- 动物叫声识别与播放应用

LiteRT-LM:开发者首选

对于开发者,Google 还提供了 LiteRT-LM 库,用于将 Gemma 4 集成到自己的应用中5。

LiteRT-LM 特性5:

- 最小内存占用:E2B 模型在部分设备上运行仅需 <1.5GB 内存

- 结构化解码:确保输出可预测、可靠

- 动态上下文:灵活支持 CPU/GPU 切换

设备性能表现3:

| 设备 | 处理器 | 性能 |

|---|---|---|

| Raspberry Pi 5 | CPU | 133 prefill / 7.6 decode tokens/s |

| Qualcomm Dragonwing IQ8 | NPU | 3,700 prefill / 31 decode tokens/s |

03 为什么 4B 是”手机模型”的甜点尺寸?

你可能会问:现在动辄上百亿参数的模型,4B 够用吗?

答案是:对手机场景来说,4B 是性能与功耗的最佳平衡点。

参数量与内存占用关系5:

| 参数量 | FP16(半精度) | INT4(4位量化) |

|---|---|---|

| 2B | ~4GB | ~1GB |

| 4B | ~8GB | ~2GB |

| 7B | ~14GB | ~3.5GB |

iPhone 的内存限制是关键约束:

- iPhone 13/14 系列:4-6GB RAM

- iPhone 15/16 Pro 系列:8GB RAM

- iPhone 17 Pro 系列:8-12GB RAM(根据型号)

4B 模型经过 INT4 量化后,只需要约 2GB 内存,为系统和应用留出足够空间6。

LiteRT-LM 官方数据3:

- E2B 在优化设备上运行内存 <1.5GB

- E4B 在 iPhone 15 Pro 上推理流畅

- 完全离线运行,不消耗网络流量

04 其他本地运行方案

除了 Google 官方方案,还有其他第三方工具可以在 iPhone 上运行 Gemma 4:

方案一:MLC LLM(开源社区)

MLC LLM(Machine Learning Compilation for LLM)是一个跨平台框架,支持在 iOS、Android、Web 等平台运行大语言模型7。

特点:

- 开源免费,社区活跃

- 支持 Gemma、Llama、Qwen 等多种模型

- 提供 iOS App,可直接安装使用

方案二:LM Studio

LM Studio 是一款流行的本地 LLM 运行工具,支持 Gemma 4 系列8。

特点:

- 跨平台支持(Windows/macOS/Linux)

- 友好的用户界面

- 支持模型量化和自定义

方案三:自建(高级用户)

对于开发者,可以通过 Xcode 编译源码,自定义模型和界面。

05 本地模型 vs 云端 API:怎么选?

| 维度 | 本地模型 | 云端 API |

|---|---|---|

| 隐私 | 数据不出设备 | 数据上传服务器 |

| 网络 | 完全离线 | 需要网络连接 |

| 成本 | 一次性下载 | 按 token 计费 |

| 速度 | 受设备性能限制 | 服务器强大 |

| 能力 | 较小模型 | 可用最强模型 |

适合使用本地模型的场景:

- 处理敏感信息(日记、财务数据)

- 旅行、通勤等无网络环境

- 需要长期高频使用,控制成本

- 对隐私有极高要求

仍需使用云端 API 的场景:

- 需要最强的推理能力(复杂任务)

- 需要多模态能力(高清图像、视频)

- 设备性能不足(旧款手机)

06 Gemma 4 在手机上的实际能力

根据 Google 官方演示,E4B 模型在手机上可以完成以下任务1:

| 任务类型 | 表现 |

|---|---|

| 文本生成 | 流畅撰写邮件、短文 |

| 知识问答 | 140+ 语言问答 |

| Agent 工作流 | 多步骤自主任务执行 |

| 文档摘要 | 128K 上下文支持长文档 |

| 多模态 | OCR、图表理解 |

需要注意的局限性:

- 复杂数学推理能力有限

- 不适合专业级代码生成

- 多轮对话上下文窗口受限

- 速度受设备性能影响

常见问题 Q&A

Q1:Gemma 4 是免费的吗?

A:是的,Gemma 4 采用 Apache 2.0 开源许可,可免费商用1。Google AI Edge Gallery 应用也免费提供。

Q2:我的 iPhone 能运行 E4B 模型吗?

A:建议 iPhone 13 及以上(A15 芯片及更新)。iPhone 17 Pro 系列体验最佳。

Q3:下载模型需要多少空间?

A:通过 Google AI Edge Gallery 下载时,应用会自动管理模型缓存。LiteRT-LM 的 E2B 模型在部分设备上仅需 <1.5GB 内存3。

Q4:本地模型会耗电很快吗?

A:推理时会增加功耗,但 E2B/E4B 经过专门优化,正常使用不会造成严重发热或耗电1。

Q5:Agent Skills 是什么?

A:Agent Skills 是 Google AI Edge Gallery 的核心功能,允许 Gemma 4 完全在设备上执行多步骤自主任务3。

参考资料

[1] Google Blog – Gemma 4: Byte for byte, the most capable open models — 模型发布、特性、许可、功耗优化

[2] Hugging Face – Gemma 4 模型家族 — 四个尺寸模型

[3] Google Developers Blog – Bring state-of-the-art agentic skills to the edge with Gemma 4 — AI Edge Gallery、Agent Skills、LiteRT-LM 性能

[4] Google AI Edge Gallery – GitHub — 官方示例代码

[5] LiteRT-LM 官方文档 — 内存占用、设备兼容性

[6] Apple 技术规格 – iPhone 内存配置 — 各机型 RAM

[7] MLC LLM 官网 — 跨平台框架

[8] LM Studio – Gemma 4 支持 — 桌面运行工具

[9] 9to5Google – Gemma 4 发布报道 — 媒体报道